在字节,A/B实验是这么做的!

主要为大家介绍了为什么要做 A/B 测试、火山引擎的 A/B 测试系统架构及字节跳动内部 A/B 测试的最佳实践。

为什么要做 A/B 测试

首先我们看一个案例。

字节跳动有一款中视频产品叫西瓜视频,最早它叫做头条视频。为了提升产品的品牌辨识度,团队想给它起个更好的名字。经过一些内部调研和头脑风暴,征集到了西瓜视频、奇妙视频、筷子视频、阳光视频 4 个名字,于是团队就针对一共 5 个 APP 名称进行了 A/B 实验。

这个实验中唯一改变的是应用市场里该产品的名称和对应的 logo,实验目的是为了验证哪一个应用名称能更好地提升“头条视频” APP 在应用商店的点击率。最后西瓜视频和奇妙视频的点击率位列前二,但差距不显著,结合用户调性等因素的综合考量后,最终决定头条视频正式更名为西瓜视频。

通过这个案例可以看到,A/B 测试可以帮助业务做最终决策。结合案例的直观感受,我们可以这样来定义 A/B 测试:在同一时间对目标受众做科学抽样、分组测试以评估效果。

以上图图示为例,假设我们有 100 万用户要进行 A/B 测试:

先选定目标受众,比如一线城市的用户。

A/B 测试不可能对所有用户都进行实验,所以要进行科学抽样,选择小部分流量进行实验。

抽样之后需要对样本进行分组,比如 A 组保持现状,B 组的某一个因素有所改变。

分组之后在同一时间进行实验,就可以看到改变变量后用户行为的变化。

再根据对应实验目标的指标,比如点击率的高低,来评估实验的结果。

以上就是我们对 A/B 测试的定义。

目前,A/B 测试已被 Google、Facebook、亚马逊等大型互联网公司广泛采用;字节跳动更是在 2012 年成立之初便开始使用 A/B 测试,公司内部一直流传一句话:一切皆可 A/B 测试。

A/B 测试在字节跳动已是非常基础的设施和文化,目前,字节跳动日新增实验 1500+,那我们为什么要做 A/B 测试呢?主要有 3 点原因:

风险控制:小流量实验可以避免直接上线效果不好造成损失。其次,实验迭代的过程中,决策都是有科学依据的,可以避免系统性的偏差。

因果推断:我们相信 A/B 实验中的优化和改变最终能影响到线上数据以及用户的行为。在这个前提下,A/B 测试就是最好的因果推断工具。

复利效应:A/B 测试是可以持续不断进行的实验,即使一次实验提升的效果不大,但是长期下来复利效应的积累会产生很大的变化和回报。

A/B 测试系统实现

了解了我们为什么要做 A/B 测试,下面我们来看一下火山引擎的 A/B 测试系统是如何实现的。

上图是火山引擎 A/B 测试系统的架构示意图,整体架构分为几层:

运行环境层:在最底层,服务可以运行在容器内,也可以运行在物理机上。

基础设施层:会用到关系型数据库和键值对。因为 A/B 测试要处理很大的数据量,这一层也会使用离线和实时的大数据组件。

服务层:包括实验所需的分流服务、元信息服务、调度服务等。在 A/B 测试中我们也需要标识用户,因此这一层有设备服务。为了提供多种数据查询,还有 OLAP 引擎。

业务层:包括实验管理、指标管理、Feature 管理、评估报告等。

接入层:包括 CDN、网络防火墙、负载均衡。

应用层:提供管理后台控制实验、查看报告等,SDK 调用。

下面介绍几个实验流程的实现:

客户端实验参数传递及生效过程

客户端实验的流程如上图所示:

业务方开发策略,确定实验内容;

枚举策略中的映射关系并在客户端实现映射关系;

创建并开启实验;

客户端已经集成了火山引擎 A/B 测试系统的 SDK,向 A/B 测试系统请求分流服务,判断用户命中哪些实验哪些版本,下发参数;

客户端从 SDK 取到参数,进行相对应的流程完成实验。

服务端实验参数传递及生效过程

服务端的实验和客户端类似:

设计实验;

服务端实验的 SDK 是跟业务系统比如服务端集成在一起。客户是从其他 C 端用户直接请求业务的服务端,该服务端会在本地 SDK 做决策;

决策完之后将参数下发到下游,使策略生效;

统计分析实践

在统计分析中,我们总结了一些有用的实践经验:

确定业务的指标体系:可以从宏观/微观、长期/短期、横向/纵向三个角度建设指标体系。

分类检验:对指标进行置信度计算的时候,并不会每次都用同一套方法,而是针对不同的指标类型(包括转化类、人均类、CTR 类等)进行不同的建模采用不同的方法。

统计修正:如果一个实验开了多个组,可能犯了多重比较的错误。还有时开完实验之后每天都会查看结果,这就犯了连续观测的错误。所以在实践中需要有一些统计修正的方法来修正行为。

基于叶贝斯体系的探索:区别于经典的假设检验,我们也在探索基于叶贝斯体系,如何评估实验效果,降低面向用户使用时候的理解门槛。在智能流量调优、模型超参数搜索等场景下有具体落地。

这里也跟大家分享一些 A/B 实验设计背后的思考:

避免过度曝光:A/B 实验中有一个很关键的点是决策哪些样本应该进入实验。如果所有打开应用的人都能命中实验,实验结果就不会很明显。

进组和出组:假设我们对北京的用户进行了实验,有些人出差或者旅游离开北京之后还能命中实验吗?我们可以把这个决策留给实验者,让实验者自己决定是进组还是出组。

和 Feature Flag 的珠联璧合:实验之前可以把能进行实验的内容抽象成 Feature Flag,简单理解成功能开关。实验完成之后的上线或者重复实验,也可用 Feature Flag 进行管理。

字节跳动 A/B 测试最佳实践

在字节跳动,A/B 测试已经是一种企业文化,大家都认可其价值,达成共识才能一起探讨。A/B 测试跟其他环节是紧密相关的。

我们在收集和分析数据之后会得到一些洞察,基于这些洞察可以知道有些环节是比较薄弱的,可进行提升,然后就可以提出假设,设计 A/B 实验,完成实验之后评估效果。

有可能实验没有达到预期效果,可以对实验进行迭代继续收集数据,这样就形成了以 A/B 测试为核心的业务增长闭环。

下面为大家介绍如何完整进行一次 A/B 实验。

如何产生好的实验想法

关于如何产生好的实验想法,我们可以从定量分析和定性分析几个角度来看。前面提到的构建完善的指标体系就是定量分析,这里不再赘述。在收集到指标数据以后,对于指标发生的异动进行现象分析,针对已存在问题(非异动),则可以进行新的产品策略或者运营策略迭代执行。

定性分析可以分为三个方面:

产品本身的价值主张是什么?比如一款打车 APP 的价值主张是通过共享经济实现社会的效率提升,这个产品有没有很好地体现价值主张?可以从这一方面产生一些实验想法。

推动因素

相关性:同一个页面中如果有不相关的功能,用户大概率也不会点击,这样的设计就没有效果。

清晰度:要表达的内容(比如命名)是否足够清晰。

紧迫性:对于有时间周期的活动,可以设计一些事件营造紧迫感。

- 阻碍因素

注意力分散:避免在一个页面放五花八门的信息让用户找不到重点。

焦虑性:有的地方可能给了用户很多选择,也会造成选择困难,不自觉地形成一种焦虑感,不如简单一些只设计一个选择。

如何建立一个有效的实验假设

我们需要针对一个用户群体做出改变,然后产生一定的影响。但是这个假设不是无脑定的,要有逻辑性是合理的,最终能通过指标来评估变化的影响。针对这几个要素,我们总结出了设计 A/B 实验的 PICOT 原则,即 Population、Intervention、Comparison、Outcome、Time,明确对什么样的用户做出了什么样的改变,然后进行分组比较,最终需要设计衡量结果的指标,并决策实验要进行多长时间。

A/B 测试效果评估

- 看哪些数据

上图是一份 A/B 测试实验报告,可以看到指标在实验版本里是绝对值,还有变化值以及置信区间。置信区间是指假设策略全量上线,你有 95% 的把握会看到真实的指标收益在 [,] 这个范围内。

置信区间越窄且不包含 0,可信度就越高。

从「查看图表」进入选择差异值可以观察累计 diff 趋势图,如果呈现置信区间逐渐变窄的现象,说明随着样本量越来越大,我们对评估结果的信心就越来越强。

指标变化是显著的吗

A/B 实验的结果有以下几种:

正向显著:说明当前样本容量条件下,实验版本优于对照版本,实验结果和假设一致;

负向显著:说明当前样本容量条件下,实验版本不优于对照版本,实验结果和假设不一致;

不显著:

确实不显著:可以参考 MDE 指标是否符合预期,如果符合,则说明结果确实不显著。

其他原因导致的不显著:比如样本容量小,指标对应的用户行为渗透率低,实验时长较短等。在这些情况下,如果实验效果不显著,可以进一步优化实验,比如增大样本量,扩大流量、再观察一段时间积累更多进组用户等。

接下来我们可以再看两个案例。

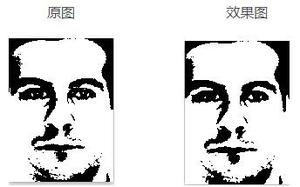

哪个首页新 UI 版本更受欢迎

今日头条 UI 整体风格偏大龄被诟病已久,不利于年轻和女性用户泛化,历史上几次红头改灰头实验都对大盘数据显著负向。因此团队设计了 A/B 实验,目标是在可接受的负向范围内,改一版用户评价更好的 UI。通过控制变量法,对以下变量分别开展数次 A/B 实验:

头部色值饱和度

字号

字重

上下间距

左右间距

底部 tab icon

结合用户调研(结果显示:年轻用户和女性用户对新 UI 更偏好)

综合来看,效果最好的 UI 版本如图 2 所示,全量上线。

新 UI 上线后,Stay duration 显著负向从-0.38% 降至 -0.24%,图文类时长显著 +1.66%,搜索渗透显著 +1.47%,高频用户(占 71%)已逐渐适应新 UI。

选择更优的视频上滑引导产品形态

某款短视频在刚面世时,很多用户都不知道上滑的玩法,因此就设计实验验证如何能更好地引导用户上滑。实验目标定为优化后提升新用户留存,上滑操作渗透率提升 1%,错误操作渗透率下降 1%。定向受众为新用户,面向 10% 的线上流量进行为期 1 个月的实验。

我们做了两轮实验,第一轮实验结果并不符合预期,上滑操作渗透率下降 1% 且显著,错误操作渗透率提升 1.5%,不符合预期。新用户留存未见显著上升。但在不符合预期的情况下,还是能做一些分析来发现原因。因此经过改进我们做了第二轮实验,结果上滑操作渗透率上升 1.5% 且显著,新用户 7 日内留存提升 1%-1.8%,且指标结果呈显著,符合预期。

上面的例子就说明了我们可以把 A/B 测试当成一个理解用户的工具。

展望

最后想跟大家一起展望一下 A/B 测试行业未来的情况。

- 从行业前景来看:

认知率和普及率在高速提升:我们之前做过一个调研,发现 A/B 测试在国内整体认知度较低,可能低到一个难以想象的数字。我们认为在未来 5-10 年内,A/B 测试的认知度可能会有 50-100 倍的提升,这个市场还是一片蓝海。

从 nice-to-have 到 must-have:现在很多人认为 A/B 测试是一个锦上添花的工具,但在数据驱动越来越重要的今天,A/B 测试是必须要掌握的工具,是企业开展业务过程中的刚需,否则在行业竞争中就会失去优势。

破圈:

我们也发现 A/B 测试正在破圈。大家的印象中 A/B 测试只有互联网公司会用,但是我们在交流的过程中发现,很多传统企业虽然没有线上业务,但如果能解决数据收集的问题,A/B 测试也能满足传统企业优化的诉求。

从技术趋势上来看,有这样几个发展方向:

智能化:A/B 测试目前还处在早期阶段,一些实验结论或实验洞察对数据和用户属性的利用还不是很充分。如果 A/B 测试能和统计方法、算法模型相结合,很可能提高整个行业的水平。

场景化:很多场景还没有开始使用 A/B 测试,未来更多的行业场景能和 A/B 测试相结合,让 A/B 测试更易用。

被集成:目前我们的 A/B 测试平台可以一站式管理实验、查看报告,但是一些用户的业务已经很成熟,希望 A/B 测试能够走入业务和系统,更顺滑地使用。所以 A/B 测试技术也需要提高自身被集成的能力,无缝地和各种业务、系统结合起来。

产品介绍

火山引擎A/B测试

摆脱猜测,用科学的实验衡量决策收益打造更好的产品,让业务的每一步都通往增长。

关联阅读

相关文章:注意,你所做的 A/B 实验,可能是错的!

欢迎关注字节跳动数据平台同名公众号

以上是 在字节,A/B实验是这么做的! 的全部内容, 来源链接: utcz.com/z/536247.html