torch.nn.Conv2d 为什么只定义卷积核的大小,而不定义卷积核的具体数值

#输入通道是 3 , 输出通道是 5 , 卷积核大小是 3 * 3x=torch.nn.Conv2d(in_channels=3,out_channels=4,kernel_size=3,groups=1)

为什么这一步只定义卷积核的大小,但是不定义具体的数值呢?

#创建一个输入:样本数 1 ,输入通道是 3 ,行数是 5 , 列数也是5

input=torch.ones(1,3,5,5)

#将 x 作用于 输入上out=x(input)

看了卷积的知识,卷积应该是 卷积核 与 输入参数 的对应位置 相乘,再相加的过程。

为什么pytorch 中不用定义卷积核的具体的数值呢,

没有具体值 要用什么数来相乘呢?

回答:

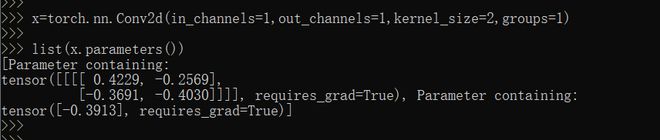

知道了 ,卷积核都是随机的,可以通过 list(x.parameters()) 来查看随机出来的值。

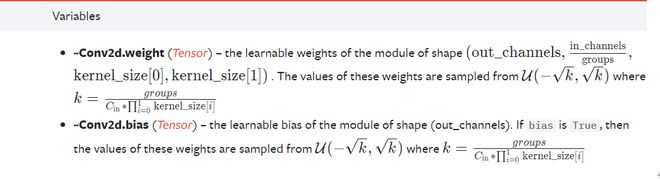

随机值的取值范围可以参考官方文档。

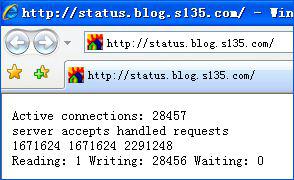

https://pytorch.apachecn.org/...

回答:

卷积核里面的参数,只是一开始是随机数,它本身是需要训练的权重值,只是一开始被初始化了为随机数,并不是一直都是随机数,它会随着网络的训练,逐渐发生变化,最后生成固定的权重值。

以上是 torch.nn.Conv2d 为什么只定义卷积核的大小,而不定义卷积核的具体数值 的全部内容, 来源链接: utcz.com/a/156628.html