基于Python的慢性病数据复杂条件查重方法实现及改进

近期因为工作需要,对原来的SAS慢性病监测数据季报审核程序进行了Python的重构,在重写的过程中,发现查重部分特别有意思,写出来和大家分享一下。

在网上说起查重,大部分的搜索结果是用pandas里的df.drop_duplicates()方法来实现的,参数"keep="可以实现去除所有重复值(keep=False),也可以保留非重复+重复记录中的首条(keep="first"),但是这两个功能和我们需要“筛选所有重复的记录”的目标还是有一定的差距,所以结合这个函数的方法,我做了一点改进,以心脑病数据为例来实现查重的过程。

先从简单条件开始,单变量查重(身份证号相同的重复卡):

# -*- coding: utf-8 -*-import pandas as pd

################################

##中间省略导入和数据前处理的过程###

################################

data1=xnxg_chk.drop_duplicates("VC_HZSFZH",keep="first")#无重复清单+每组重复记录的第一条

data2=xnxg_chk.drop_duplicates("VC_HZSFZH",keep=False) #无重复清单

xnxg_dup=xnxg_chk[xnxg_chk["VC_BGKBH"].isin(list(set(xnxg_chk["VC_BGKBH"]).difference(set(data2["VC_BGKBH"]))))]##结果为重复卡总张数数

xnxg_pair=data1[data1["VC_BGKBH"].isin(list(set(data1["VC_BGKBH"]).difference(set(data2["VC_BGKBH"]))))]##结果为重复卡总对子数

list(set(xnxg_chk["VC_BGKBH"]).difference(set(data2["VC_BGKBH"]))) 这个部分中,将xnxg_chk(心脑总库)与data2取了个差集,结果就是所有的重复卡数,data1和data2取差集后,得到的是重卡对子数。由于xnxg_chk["VC_BGKBH"]这样取出来的是一个Series,不能直接用.difference()的方法,所以用list()和set()的嵌套做了个转换。

但是缺点也显而易见,就是如果涉及多条件的组合查询,比如“姓名+性别+出生日期”这样,或者需要“身份证号/姓名+性别+出生日期”,去交集/并集/差集的关系会很让人很困扰,而且心脑查重当中“两次发病时间间隔小于28天”这样的复杂条件也是实现不了。于是我重新设计了一下,采用嵌套for循环+if条件语句来实现。

# -*- coding: utf-8 -*-import pandas as pd

################################

##中间省略导入和数据前处理的过程###

################################

xnxg_d1=xnxg_chk

xnxg_d2=xnxg_chk

for i in range(len(xnxg_d1)):

for j in range(len(xnxg_d2)):

if xnxg_d1["VC_BGKBH"].iloc[i]!=xnxg_d2["VC_BGKBH"].iloc[j]

and pd.Timedelta(abs(xnxg_d1["fbrq"].iloc[i]-xnxg_d2["fbrq"].iloc[j])).days<29

and (xnxg_d1["VC_HZSFZH"].iloc[i]==xnxg_d2["VC_HZSFZH"].iloc[j]

and len(xnxg_d1["VC_HZSFZH"].iloc[i])>14 and len(xnxg_d2["VC_HZSFZH"].iloc[j])>14

or xnxg_d1["VC_HZXM"].iloc[i]==xnxg_d2["VC_HZXM"].iloc[j]

and xnxg_d1["VC_HZXB"].iloc[i]==xnxg_d2["VC_HZXB"].iloc[j]

and xnxg_d1["csrq"].iloc[i]==xnxg_d2["csrq"].iloc[j])

and xnxg_d1["VC_HZICD"].iloc[i][:3]==xnxg_d2["VC_HZICD"].iloc[j][:3]:

xnxg_dup=xnxg_dup.append(xnxg_d1.iloc[i])

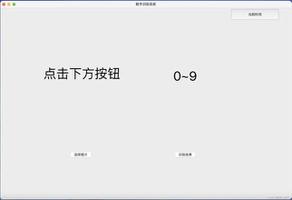

在这段程序里,先将待查数据赋值给两个库,第一个库xnxg_d1(i)从第一条开始和另一个库xnxg_d2(j)里的每一条做比对,比对的条件可以放在if条件函数里,满足条件的(i)记录放进重卡存储库xnxg_dup里。比对模拟过程图如下:

假设第1和第3条数据为满足查重条件的重卡对子,那么在for循环过程中,当i=1,j=3时,输出查重结果i=1到重卡数据集xnxg_dup里,当i=3,j=1时,输出查重结果i=1到重卡数据集xnxg_dup里。

该方法可以成功进行复杂条件的查重,比如心脑的28天时间间隔条件,但缺点是耗时较久。匹配的次数为N×N次,1.2w数据全部跑完需要约45分钟。

通过对右图的观察可以发现,for循环中是有将近一半的比对是冗余的,比如i=1,j=2与i=2,j=1,因此我们只要将xnxg_d1库中的参与过比对的数据,从xnxg_d2中拿掉,就可以将冗余比对去除了,优化后的模拟过程图如下:

优化后的算法计算量减少了一半左右,但是需要注意的是前面的重卡库xnxg_dup只要取d1中的结果就可以了,但是在下面的重卡库里,d1和d2的结果都要取,否则出来的结果不完整。

如果将d1和d2按照地市或者区县进一步细分,再用循环分别来跑的话,所用时间将大大少于合并在一起跑的时间。

最后的查重程序优化如下,注意增加的优化代码添加的位置:

# -*- coding: utf-8 -*-import pandas as pd

################################

##中间省略导入和数据前处理的过程###

################################

xnxg_d1=xnxg_chk

xnxg_d2=xnxg_chk

for i in range(len(xnxg_d1)):

xnxg_d2=xnxg_d2.drop(xnxg_d1.index[i])##优化增加内容

for j in range(len(xnxg_d2)):

if xnxg_d1["VC_BGKBH"].iloc[i]!=xnxg_d2["VC_BGKBH"].iloc[j]

and pd.Timedelta(abs(xnxg_d1["fbrq"].iloc[i]-xnxg_d2["fbrq"].iloc[j])).days<29

and (xnxg_d1["VC_HZSFZH"].iloc[i]==xnxg_d2["VC_HZSFZH"].iloc[j]

and len(xnxg_d1["VC_HZSFZH"].iloc[i])>14 and len(xnxg_d2["VC_HZSFZH"].iloc[j])>14

or xnxg_d1["VC_HZXM"].iloc[i]==xnxg_d2["VC_HZXM"].iloc[j]

and xnxg_d1["VC_HZXB"].iloc[i]==xnxg_d2["VC_HZXB"].iloc[j]

and xnxg_d1["csrq"].iloc[i]==xnxg_d2["csrq"].iloc[j])

and xnxg_d1["VC_HZICD"].iloc[i][:3]==xnxg_d2["VC_HZICD"].iloc[j][:3]:

xnxg_dup=xnxg_dup.append(xnxg_d1.iloc[i])

xnxg_dup=xnxg_dup.append(xnxg_d1.iloc[j])##优化增加内容

以上是 基于Python的慢性病数据复杂条件查重方法实现及改进 的全部内容, 来源链接: utcz.com/z/534908.html