pytorc人工神经网络Logisticregression与全连接层

//2019.10.08

神经网络与全连接层

1、logistics regression

逻辑回归的思想是将数据利用激活函数sigmoid函数转换为0-1的概率,然后定义一定的阈值0.5,大于阈值则为一类,小于阈值则为另一类。它主要用来解决的是二分类问题,也可以通过一定的变形解决多分类的问题。

2、对于逻辑回归其实质是分类算法,为什称之为回归,主要是因为其优化的函数类似于回归问题的loss函数,而将其称之为逻辑主要是因为利用了sigmoid函数。

图

3、回归问题和分类问题的loss函数是不一样:

(1)回归问题:MSE

(2)分类问题:

1)MSE(P)

2)cross entropy loss

3)Hinge Loss

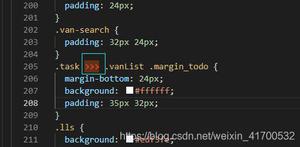

图

4、cross entropy loss交叉熵:主要是指整体预测的不确定性,即熵的概念,熵的值越大,说明其确定性越低,概率分布越接近;熵的值越小,说明确定性越高,概率预测分布相差越大,越逼近极端的0或者1。

图123

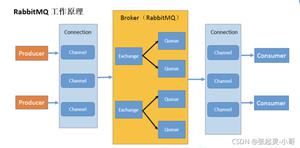

5、交叉熵函数cross_entropy=softmax+log+null_loss函数

图

6、激活函数主要有以下几种:sigmoid函数、tanh函数、Relu函数,改进版Relu函数,selu函数,softplus函数

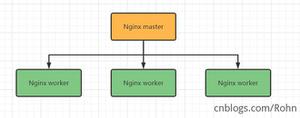

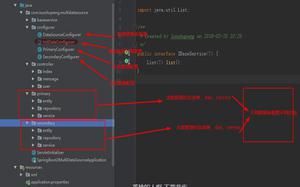

7、一个神经网络层结构的搭建组成具体如下所示:

以上是 pytorc人工神经网络Logisticregression与全连接层 的全部内容, 来源链接: utcz.com/z/509840.html