day3Python爬虫入门 - 叶巳瑾

day3Python爬虫入门

一 爬虫原理

1、什么是互联网?

互联网其实是由一堆网络设备(比如: 网线、路由器、交换机、防火墙等等...)与一台台的计算机连接而成,就像一张蜘蛛网一样。

2、互联网建立的目的

互联网的核心价值: 数据是存放在一台台计算机中的,而互联网是把计算机互联到一起,也就是说把一台台计算机中的数据都捆绑到一起了,目的就是为了能够方便每台计算机彼此之间数据的传递与数据的共享,否则你只能拿到U盘或者是移动硬盘去别人的计算机上拷贝数据了。

3、什么是上网?

上网其实指的是有用户端(客户端)的计算机向目标计算机发送请求,将目标计算机的数据下载到客户端计算机的过程。

1、普通用户获取数据的方式:浏览器提交请求 --->下载页面代码 ---> 解析/渲染成页面。

2、爬虫程序获取数据的方式:模拟浏览器提交请求 --->下载页面代码 ---> 只提取有用的数据---> 存放于数据库中或文件中。

3、普通用户和爬虫程序的区别:

普通用户: 普通用户是通过打开浏览器访问网页,浏览器会接收所有的数据。

爬虫程序: 爬虫程序只提取网页代码中对我们有价值的数据。

4、浏览器发送的是什么请求?

http协议的请求。注:https:http+ssl:

---客户端:浏览器是一个软件--->客户端的IP和端口

---服务器:

https://www.jd.com/

www.jd.com(京东域名)--->DNS解析--->京东服务器的IP和端口

客户端的IP和端口-------->京东服务器的IP和端口发送请求可以建立链接获取相应数据

5、爬虫的全过程

1、发送请求(需要请求库:Requests请求库,Selenium请求库)

2、获取响应数据(只要往服务器发送请求,请求通过后会返回响应数据)

3、解析并提取数据:(需要解析库:re、BeautifulSoup4、Xpath)

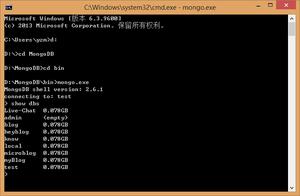

4、保存到本地(文件处理、数据库、MongoDB存储库)

二 Requests请求库

1、安装和使用

—打开cmd

—输入:pip3 install requests

或者也可以在Pycharm中进行安装

同时还需要去配置环境变量,具体流程如下:

部分requests函数的使用:

2、抓包分析

打开浏览器的开发者模式(检查)----> 选中network

找到访问的页面后缀 xxx.html(响应文本)

(1)请求url(访问的网站地址)

(2)请求方式:

GET:

直接发送请求获取数据

https://www.cnblogs.com/kermitjam/articles/9692597.html

POST:

需要携带用户信息往目标地址发送请求

https://www.cnblogs.com/login

(3) 响应状态码:

2xx: 成功

3xx: 重定向

4xx: 找不到资源

5xx: 服务器错误

(4) 请求头信息:

User-Agent: 用户代理(证明是通过电脑设备及浏览器发送的请求)

Cookies: 登录用户真实信息(证明你目标网站的用户)

Referer: 上一次访问的url (证明你是从目标网站跳转过来的)

三 通过程序获得百度主页响应并可快捷进入

import requests # 导入requests请求库# 往百度主页发送请求,获取响应对象

response = requests.get(url=\'https://www.baidu.com/\')

# 设置字符编码为 utf-8

response.encoding = \'utf-8\'

# 打印响应文本

print(response.text)

# 把响应文本写入本地

with open(\'baidu.html\', \'w\', encoding=\'utf-8\') as f:

f.write(response.text)

在程序运行后,可以得到一个baidu.html文件,可以通过这个文件直接进入百度主页。

四 从梨视频上保存视频到本地

从这个视频源地址上获得视频并保存到本地

import requests# 往视频源地址发送请求

response = requests.get(\'https://video.pearvideo.com/mp4/adshort/20190625/cont-1570302-14057031_adpkg-ad_hd.mp4\')#语句必须写在一起

# # 打印二进制流,比如图片、视频等数据

print(response.content)

# 保存视频到本地

with open(\'视频.mp4\', \'wb\') as f:

f.write(response.content)

在梨视频主页获取所有的视频信息并保存视频

\'\'\'1、先往梨视频主页发送请求

https://www.pearvideo.com/

解析获取所有视频的id:

video_1570302

re.findall()

2、获取视频详情页url:

惊险!男子抢上地铁滑倒,就脚进去了

https://www.pearvideo.com/video_1570302

揭秘坎儿井

https://www.pearvideo.com/video_1570107

\'\'\'

import requests

import re # 正则,用于解析文本数据

# 1、先往梨视频主页发送请求

response = requests.get(\'https://www.pearvideo.com/\')

# print(response.text)

# re正则匹配获取所有视频id

# 参数1: 正则匹配规则

# 参数2: 解析文本

# 参数3: 匹配模式

res_list = re.findall(\'<a href="video_(.*?)"\', response.text, re.S)

# print(res_list)

# 拼接每一个视频详情页url

for v_id in res_list:

detail_url = \'https://www.pearvideo.com/video_\' + v_id

# print(detail_url)

# 对每一个视频详情页发送请求获取视 频源url

response = requests.get(url=detail_url)

# print(response.text)

# 解析并提取详情页视频url

# 视频url

video_url = re.findall(\'srcUrl="(.*?)"\', response.text, re.S)[0]

print(video_url)

# 视频名称

video_name = re.findall(

\'<h1 class="video-tt">(.*?)</h1>\', response.text, re.S)[0]

print(video_name)

# 往视频url发送请求获取视频二进制流

v_response = requests.get(video_url)

with open(\'%s.mp4\' % video_name, \'wb\') as f:

f.write(v_response.content)

print(video_name, \'视频爬取完成\')

获取豆瓣电影top250榜单

\'\'\'\'\'\'\'\'\'

https://movie.douban.com/top250?start=0&filter=

https://movie.douban.com/top250?start=25&filter=

https://movie.douban.com/top250?start=50&filter=

1.发送请求

2.解析数据

3.保存数据

\'\'\'

import requests

import re

# 爬虫三部曲

# 1.发送请求

def get_page(base_url):

response = requests.get(base_url)

return response

# 2.解析文本

def parse_index(text):

res = re.findall(\'<div class="item">.*?<em class="">(.*?)</em>.*?<a href="(.*?)">.*?<span class="title">(.*?)</span>.*?导演:(.*?)</p>.*?<span class="rating_num".*?>(.*?)</span>.*?<span>(.*?)人评价</span>.*?<span class="inq">(.*?)</span>\', text, re.S)

# print(res)

return res

# 3.保存数据

def save_data(data):

with open(\'douban.txt\', \'a\', encoding=\'utf-8\') as f:

f.write(data)

# main + 回车键

if __name__ == \'__main__\':

# num = 10

# base_url = \'https://movie.douban.com/top250?start={}&filter=\'.format(num)

num = 0

for line in range(10):

base_url = f\'https://movie.douban.com/top250?start={num}&filter=\'

num += 25

print(base_url)

# 1.发送请求,调用函数

response = get_page(base_url)

# 2.解析文本

movie_list = parse_index(response.text)

# 3.保存数据

# 数据的格式化

for movie in movie_list:

# print(movie)

# 解压赋值

# 电影排名、电影url、电影名称、导演 - 主演 - 类型、电影评分、评价人数、电影简介

v_top, v_url, v_name, v_daoyan, v_point, v_num, v_desc = movie

# v_top = movie[0]

# v_url = movie[1]

moive_content = f\'\'\'

电影排名: {v_top}

电影url: {v_url}

电影名称: {v_name}

导演主演: {v_daoyan}

电影评分: {v_point}

评价人数: {v_num}

电影简介: {v_desc}

\n

\'\'\'

print(moive_content)

# 保存数据

save_data(moive_content)

以上是 day3Python爬虫入门 - 叶巳瑾 的全部内容, 来源链接: utcz.com/z/387255.html